The Facebook dilemma: samenvatting en duiding

De documentaire ‘The social dilemma’ verwierf in 2020 grote bekendheid nadat Netflix deze in haar aanbod had opgenomen. De documentaire ‘The Facebook dilemma’ uit oktober 2018 is wellicht wat onbekender, maar is net als ‘The social dilemma’ de moeite van het kijken waard! In deze documentaire ligt de nadruk op de wijze waarop bepaalde gebruikers Facebook-accounts en -berichten inzetten om groepen tegen elkaar op te zetten. Deze post is een samenvatting en verdere verdieping van het dilemma waarvoor Facebook zich geplaatst ziet: kiezen voor een verdere groei van het platform óf optreden tegen fake accounts en fake news wat leidt tot minder omzet en minder winst. Deze post is opgebouwd uit drie delen: (1) achtergrondinformatie over de groei van Facebook; (2) de rol van Facebook bij buitenlandse conflicten en (3) de impact van fake accounts en fake news.

Deel I – De groei van Facebook

Het ontstaan van Facebook

Facebook ontstond op 4 februari 2004 als ‘theFacebook.com’. De geboorteplaats was een zolderkamer op de Harvard universiteit in Boston. Er waren vier oprichters: Mark Zuckerberg (foto), Eduardo Saverin, Chris Hughes en Dustin Moskovitz. In de eerste 24 uur sloten zich zo’n 1.200 studenten op theFacebook.com aan. Aanvankelijk stond dit platform alleen open voor Harvard-studenten en fungeerde het als een online ‘smoelenboek’. In de loop der tijd konden ook studenten van andere universiteiten zich bij Facebook aanmelden. Eind 2004 had Facebook al één miljoen actieve gebruikers. Pas in september 2006 werd Facebook opengesteld voor iedereen van dertien jaar en ouder. Facebook trok overigens al snel uit Boston weg. In juni 2004 verhuisde het naar de westkust, naar 819 La Jennifer Way in Palo Alto, Californië. Dat huis staat nu bekend als ‘The Facebook House’, de plek waar Facebook groot is geworden.

Van de oorspronkelijke oprichters is alleen Mark Zuckerberg nog over. Het aandeel van Eduardo Saverin in Facebook werd door Zuckerberg gemarginaliseerd wat in 2005 tot het vertrek van Saverin leidde. Chris Hughes verliet Facebook in 2007 en werd vrijwilliger voor de politieke campagne van Barack Obama. Dustin Moskovitz vertrok ten slotte in 2008. Mark Zuckerberg was vanaf het begin af aan degene die de leiding over Facebook had. Hij stelde zich ten doel met Facebook iedereen in de wereld met elkaar in verbinding te brengen. Dit sloot mooi aan op Google’s missie om alle informatie in de wereld ontsluiten. Kernwoorden bij Facebook zijn ‘open’, ‘connected’ en ‘give people the power to share’. Zuckerberg willde met Facebook groundbreaking zijn en zich niet laten beperken door bestaande structuren. Tot 2014 was het motto van Facebook dan ook “Move fast and break things”. Daarna is dit bijgesteld naar “Move fast with stable infra”.

Van de oorspronkelijke oprichters is alleen Mark Zuckerberg nog over. Het aandeel van Eduardo Saverin in Facebook werd door Zuckerberg gemarginaliseerd wat in 2005 tot het vertrek van Saverin leidde. Chris Hughes verliet Facebook in 2007 en werd vrijwilliger voor de politieke campagne van Barack Obama. Dustin Moskovitz vertrok ten slotte in 2008. Mark Zuckerberg was vanaf het begin af aan degene die de leiding over Facebook had. Hij stelde zich ten doel met Facebook iedereen in de wereld met elkaar in verbinding te brengen. Dit sloot mooi aan op Google’s missie om alle informatie in de wereld ontsluiten. Kernwoorden bij Facebook zijn ‘open’, ‘connected’ en ‘give people the power to share’. Zuckerberg willde met Facebook groundbreaking zijn en zich niet laten beperken door bestaande structuren. Tot 2014 was het motto van Facebook dan ook “Move fast and break things”. Daarna is dit bijgesteld naar “Move fast with stable infra”.

De razendsnelle expansie van Facebook

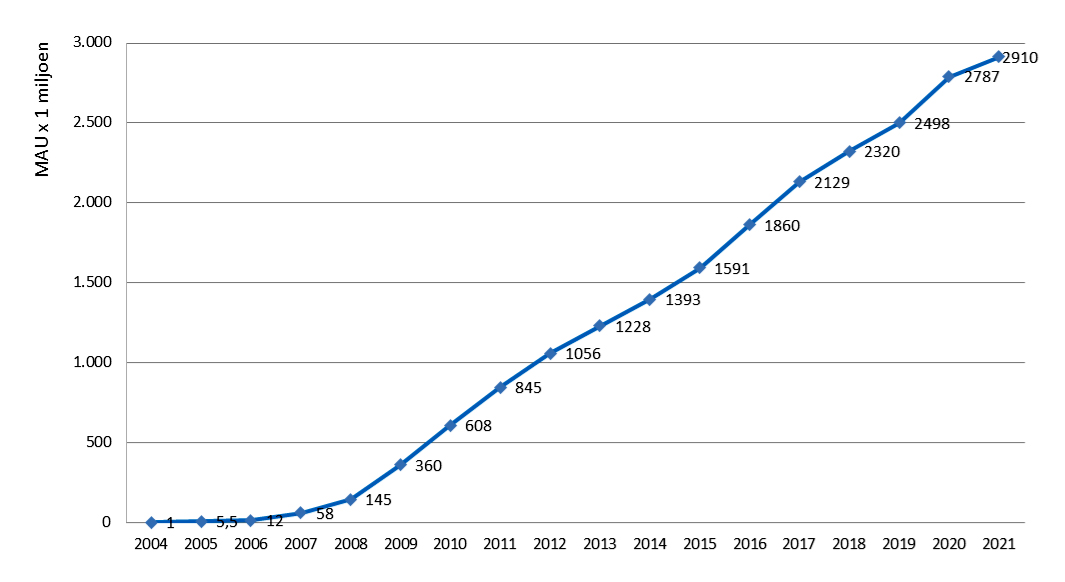

Het succes van een social media platform kan je aflezen aan het aantal ‘daily active users’ (DAU) en de daarvan afgeleide ‘monthly active users’ (MAU). Een hoge DAU betekent dat gebruikers dagelijks een platform bezoeken om ‘bij te blijven’. Je kunt het daarom ook de ‘stickyness’-factor noemen. In figuur 1 is de wereldwijde groei van Facebook in termen van MAU weergegeven. De jaartallen representeren het aantal MAU aan het eind van dat jaar (‘2008’ staat dus voor 31 december 2008). Uit deze figuur kun je aflezen dat Facebook is gegroeid van 1 miljoen gebruikers eind 2004 naar 608 miljoen gebruikers eind 2010. En vervolgens naar 1,5 miljard gebruikers eind 2015 en 2,9 miljard gebruikers eind 2021. De kans is groot dat de teller begin 2022 op meer dan 3 miljard (!) gebruikers staat. Ofwel bijna 38% van de wereldbevolking.

Figuur 1: Aantal MAU van Facebook sinds de oprichting in 2004 (NB: ‘2021’ geeft de stand van eind Q3 2021 weer)

In 2009 kwamen op smartphones social media apps beschikbaar. Gedurende de loop van dat jaar (in figuur 1 het interval tussen 2008-2009) zie je dan ook een knik in de groei van Facebook in positieve zin. In 2012 overtrof het aantal ‘mobiele gebruikers’ voor het eerst het aantal desk- en laptop gebruikers. Mark Zuckerberg deed daarop de uitspraak dat Facebook vanaf dat moment een ‘mobile company’ was geworden.

Verandering van focus

2012 was bedrijfsmatig gezien voor Facebook een bijzonder jaar. Op 18 mei van dat jaar ging het bedrijf namelijk naar de beurs en haalde $ 18 miljard op. Facebook heeft sinds haar bestaan veel overnames gedaan (kijk hier voor een overzicht van alle 86 acquisities in de periode 2005-2021). Vooral Instagram en WhatsApp zijn de moeite van het noemen waard. In april 2012 werd Instagram opgekocht voor circa $ 1 miljard. Later bleek dat Zuckerberg Instagram als een bedreiging zag. Wellicht was dit de reden waarom Facebook zoveel geld betaalde voor een bedrijf dat toen maar 13 (!) medewerkers in dienst had. En op 19 februari 2014 werd WhatsApp opgekocht voor $ 19 miljard. WhatsApp was toen pas vijf jaar oud en maakte nog nauwelijks winst. In 2013 bleek echter dat steeds meer mensen Facebook Messenger verruilden voor WhatsApp. Dus ook WhatsApp werd gezien als een potentiële bedreiging.

2012 was bedrijfsmatig gezien voor Facebook een bijzonder jaar. Op 18 mei van dat jaar ging het bedrijf namelijk naar de beurs en haalde $ 18 miljard op. Facebook heeft sinds haar bestaan veel overnames gedaan (kijk hier voor een overzicht van alle 86 acquisities in de periode 2005-2021). Vooral Instagram en WhatsApp zijn de moeite van het noemen waard. In april 2012 werd Instagram opgekocht voor circa $ 1 miljard. Later bleek dat Zuckerberg Instagram als een bedreiging zag. Wellicht was dit de reden waarom Facebook zoveel geld betaalde voor een bedrijf dat toen maar 13 (!) medewerkers in dienst had. En op 19 februari 2014 werd WhatsApp opgekocht voor $ 19 miljard. WhatsApp was toen pas vijf jaar oud en maakte nog nauwelijks winst. In 2013 bleek echter dat steeds meer mensen Facebook Messenger verruilden voor WhatsApp. Dus ook WhatsApp werd gezien als een potentiële bedreiging.

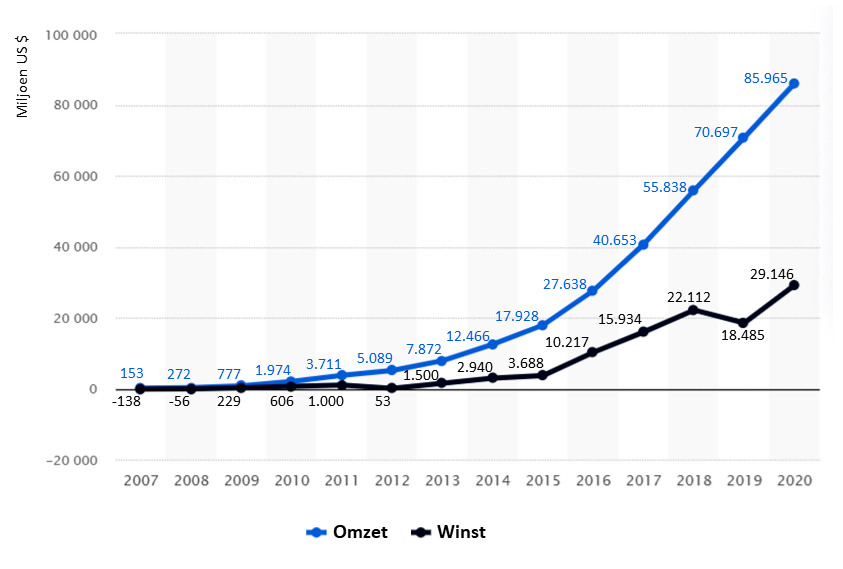

The Facebook dilemma gaat feitelijk over de vraag of Facebook mag groeien ten koste van de kwalijke gevolgen die fake accounts en fake news met zich meebrengen. De enorme groei van Facebook blijkt onder meer uit het aantal ‘monthly active users’ (MAU); zie figuur 1 hierboven. Maar de groei is ook af te lezen uit de omzet en de winst die Facebook maakt. De omzet en winst worden grotendeels bepaald door adverteerders. Hoe meer reclame op Facebook, des te groter de omzet en winst. Volgens The Facebook dilemma zijn omzet en winst altijd de belangrijkste drivers van Zuckerberg geweest. Feitelijk zegt Zuckerberg dat hij met Facebook iedereen in de wereld met elkaar in verbinding wil brengen, maar al vóór de beursgang verschoof zijn aandacht naar wat je bedrijfsmatig met die verbindingen zou kunnen doen. En dat is data mining; een proces waarin ‘ruwe’ data wordt omgezet naar waardevolle informatie.

Over data-brokers en tracking pixels

Begin 2012 ging Facebook data van gebruikers uitwisselen met data-brokers zoals Acxiom, Epsilon en Experian. Deze brokers verzamelen informatie over waar we wonen, wat we kopen, uit hoeveel personen ons huishouden bestaat, welke bladen we lezen etc. Met deze data kan Facebook betere gebruikersprofielen opstellen, wat het voor bedrijven nog aantrekkelijker maakt om op Facebook te adverteren. De data-brokers mochten op hun beurt Facebook-data gebruiken en delen met anderen, zonder dat hiervoor toestemming van Facebook nodig was. En zo kon het gebeuren dat Cambridge Analytica de profielen van 150 mln. Facebook-gebruikers inzette voor ‘political campaigning’. In april 2018 is Zuckerberg daarom door het Amerikaanse Congres ter verantwoording geroepen vanwege de ‘use and abuse of data’. Zuckerberg verdedigde zich door te stellen: “Facebook is an idealistic and optimistic company” en “Facebook is not part of the problem but the solution”. Dit schandaal betekende in ieder geval het einde van Cambridge Analytica!

Begin 2012 ging Facebook data van gebruikers uitwisselen met data-brokers zoals Acxiom, Epsilon en Experian. Deze brokers verzamelen informatie over waar we wonen, wat we kopen, uit hoeveel personen ons huishouden bestaat, welke bladen we lezen etc. Met deze data kan Facebook betere gebruikersprofielen opstellen, wat het voor bedrijven nog aantrekkelijker maakt om op Facebook te adverteren. De data-brokers mochten op hun beurt Facebook-data gebruiken en delen met anderen, zonder dat hiervoor toestemming van Facebook nodig was. En zo kon het gebeuren dat Cambridge Analytica de profielen van 150 mln. Facebook-gebruikers inzette voor ‘political campaigning’. In april 2018 is Zuckerberg daarom door het Amerikaanse Congres ter verantwoording geroepen vanwege de ‘use and abuse of data’. Zuckerberg verdedigde zich door te stellen: “Facebook is an idealistic and optimistic company” en “Facebook is not part of the problem but the solution”. Dit schandaal betekende in ieder geval het einde van Cambridge Analytica!

In het kader van data mining mag Facebook’s ‘tracking pixel’ niet ongenoemd blijven. Websites kunnen op hun pages heel kleine jpg-files van Facebook opnemen ter grootte van één pixel. Deze plaatjes zijn door gebruikers niet of nauwelijks waar te nemen. Als je een website bezoekt, stuurt je browser onder meer je schermresolutie en je IP-adres door naar die website. En als er op die website een tracking pixel van Facebook staat, ontvangt ook Facebook deze informatie. Zo komt Facebook er niet alleen achter wat je op Facebook doet, maar ook welke andere sites je hebt bezocht en wat je daar hebt gekocht. Facebook helpt vervolgens deelnemende websites gerichte remarketing-campagnes uit te voeren. Eind 2021 maakten naar schatting wereldwijd 400 miljoen (!) websites gebruik van Facebook tracking pixels. Het netwerk van heel veel verbonden mensen is zo een onuitputtelijke, zeer waardevolle bron van hoogwaardige informatie geworden!

Het verdienmodel van Facebook

Meer dan 95% van de omzet van Facebook bestaat uit reclame-inkomsten van adverteerders. In de grafiek in figuur 2 is de omzet en winst van Facebook over de periode 2007-2020 weergegeven. Deze figuur maakt duidelijk dat de omzet van Facebook in 2021 de grens van $ 100 miljard zal passeren en de winst meer dan $ 30 miljard zal bedragen. Zuckerberg is de grootste aandeelhouder, hij bezit 16,7% van alle aandelen. Iets meer dan 65% van de aandelen is in handen van institutionele beleggers zoals de Vanguard Group en BlackRock.

Figuur 2: Facebook’s omzet en winst (2007-2020) inclusief WhatsApp en Instagram (bron: www.statista.com)

Deel II – De rol van Facebook bij buitenlandse conflicten

De onschendbaarheid van Facebook

In Amerika is er een wettelijke bepaling – sectie 230 van de Communications Decay Act – die stelt: “No provider or user of an interactive computer service shall be treated as the publisher or speaker of any information provided by another information content provider”. Praktisch betekent dit dat Facebook niet verantwoordelijk kan worden gehouden voor door derden geüploade content. Wel hanteert Facebook enkele eigen gedragsregels, namelijk “basic decency, no nudity, no violence or hateful speech”. Ook is het opmerkelijk dat Amerika geen, voor alle staten geldende, wet heeft die het verzamelen van persoonsgegevens verbiedt. Daardoor konden de misstanden bij Cambridge Analytica ontstaan.

The Facebook dilemma gaat in op een aantal buitenlandse conflicten. Hierbij controleerde Facebook niet of nauwelijks de inhoud van de posts die gebruikers tijdens deze conflicten verspreidden. Zo zou Facebook een katalyserende rol hebben gespeeld in onder meer de Arabische wereld, bij de ‘war on drugs’ op de Filipijnen en bij de verdrijving van moslims uit Myanmar.

De Arabische Lente

Van 2010 tot 2012 was er in het Midden-Oosten sprake van de ‘Arabische lente’. Grote volksmassa’s protesteerden toen tegen het dictatoriale regime in hun land. In Egypte laaide het vuur op na de dood van de 28-jarige Khaled Saïd (foto). Hij had een video online gezet waarin was te zien dat politieagenten in beslag genomen geld en drugs onderling verdeelden. Kaled Said is vervolgens op 6 juni 2010 in een internetcafé in Alexandrië door twee politiemannen opgepakt en doodgeslagen. Na zijn dood lanceerden Wael Ghonim en Abdelrahman Mansour de Facebook-pagina “We are all Khaled Saïd”. Op deze pagina stelden zij de misstanden van het regime van president Hosni Mubarak aan de kaak en riepen ze op tot protest. Begin 2011 had deze Facebook-pagina al 350.000 volgers. De daarop volgende massale protesten op het Tahrirplein in Caïro werden wereldnieuws en leidden ertoe dat president Mubarak op 11 februari 2011 aftrad.

Van 2010 tot 2012 was er in het Midden-Oosten sprake van de ‘Arabische lente’. Grote volksmassa’s protesteerden toen tegen het dictatoriale regime in hun land. In Egypte laaide het vuur op na de dood van de 28-jarige Khaled Saïd (foto). Hij had een video online gezet waarin was te zien dat politieagenten in beslag genomen geld en drugs onderling verdeelden. Kaled Said is vervolgens op 6 juni 2010 in een internetcafé in Alexandrië door twee politiemannen opgepakt en doodgeslagen. Na zijn dood lanceerden Wael Ghonim en Abdelrahman Mansour de Facebook-pagina “We are all Khaled Saïd”. Op deze pagina stelden zij de misstanden van het regime van president Hosni Mubarak aan de kaak en riepen ze op tot protest. Begin 2011 had deze Facebook-pagina al 350.000 volgers. De daarop volgende massale protesten op het Tahrirplein in Caïro werden wereldnieuws en leidden ertoe dat president Mubarak op 11 februari 2011 aftrad.

Nadat president Mubarak was afgetreden, ging in Egypte het verbale geweld op Facebook door. Maar nu keerden de bevolkingsgroepen (moslims, christenen en de moslimbroederschap) zich tegen elkaar. Wael Ghonim zei hierover: “The tool (Facebook) that brought us together, was now tearing us apart!”. En Facebook? Die had geen grip op de inhoud van de content. Deels omdat ze dat niet als hun taak zagen; Facebook opereert immers onder sectie 230 van de Amerikaanse Communications Decay Act. En deels omdat de opruiende content in het Arabisch was geschreven, een taal die men bij Facebook niet machtig was. Een ander belangrijk gegeven was dat Facebook zich op een beursgang aan het voorbereiden was. Het veranderen van het algoritme dat bepaalt welke content op Facebook het meest wordt gedeeld, zou er hoogstwaarschijnlijk toe leiden dat het aantal daily active users zou dalen. En dat is nou net niet in het belang van adverteerders!

Facebook op smartphones: een uiterst explosieve cocktail

Bij conflicten tussen bevolkingsgroepen worden posts op Facebook geplaatst die veel in/out-group signalen bevatten. In dit soort posts wordt de eigen groep (de ‘in-group’) opgehemeld en wordt over de andere groep (de ‘out-group’) kwaad gesproken. Dergelijke posts krijgen gewoonlijk veel likes, shares en comments omdat de eigen groep deze waardeert. Het gevolg hiervan is dat dit polarisatie van bevolkingsgroepen in de hand werkt. Je kunt dus concluderen dat Facebook (onbewust) een belangrijke facilitator van de Arabische Lente was. Daarnaast maakte de smartphone het mogelijk dat ‘berichten van de straat’ direct werden gedeeld. Hierboven gaven we aan dat in 2009 social media apps op smartphones beschikbaar kwamen. Onderzoek heeft aangetoond dat posts en comments die vanaf smartphones zijn geüpload vaak korter, oppervlakkiger en emotioneler van aard zijn, dan die vanaf computers. Tijdens de Arabische lente vormde de combinatie van Facebook en smartphones zo een uiterst explosieve cocktail!

Misstanden in Azië

Een ander buitenlandse conflict waar Facebook een rol speelde, is Myanmar (het voormalige Birma). Van de Myanmarese bevolking is 88% boeddhistisch, 6% christelijk en 4% moslim. De moslims (Rohingya) kwamen in 2014 onder vuur te liggen toen op Facebook het nepbericht verscheen: “Moslim heeft Boeddhistische vrouw verkracht”. De rellen die daarop volgden leidden tot twee doden. Voor velen was dit het bewijs dat berichten op Facebook tot ‘real world harm’ kunnen leiden. Later laaide het vuur opnieuw op; eind 2016 ontstond er een eerste geweldsgolf tegen de Rohingya. En in augustus 2017 volgde een tweede geweldsgolf. De Myanmarese machthebbers plaatsten toen berichten op Facebook en Twitter om de haat tegen de Rohingya aan te wakkeren. Met als gevolg dat meer dan 24.000 Rohingya werden vermoord, meer dan 18.000 Rohingya-meisjes en -vrouwen werden verkracht en meer dan 700.000 Rohingya op de vlucht sloegen.

Een ander buitenlandse conflict waar Facebook een rol speelde, is Myanmar (het voormalige Birma). Van de Myanmarese bevolking is 88% boeddhistisch, 6% christelijk en 4% moslim. De moslims (Rohingya) kwamen in 2014 onder vuur te liggen toen op Facebook het nepbericht verscheen: “Moslim heeft Boeddhistische vrouw verkracht”. De rellen die daarop volgden leidden tot twee doden. Voor velen was dit het bewijs dat berichten op Facebook tot ‘real world harm’ kunnen leiden. Later laaide het vuur opnieuw op; eind 2016 ontstond er een eerste geweldsgolf tegen de Rohingya. En in augustus 2017 volgde een tweede geweldsgolf. De Myanmarese machthebbers plaatsten toen berichten op Facebook en Twitter om de haat tegen de Rohingya aan te wakkeren. Met als gevolg dat meer dan 24.000 Rohingya werden vermoord, meer dan 18.000 Rohingya-meisjes en -vrouwen werden verkracht en meer dan 700.000 Rohingya op de vlucht sloegen.

In India werd de kwalijke, faciliterende rol van Facebook duidelijk toen twee mannen door een menigte werden vermoord omdat de bevolking ze ten onrechte verdacht van het kidnappen van kinderen. In juni 2018 arresteerde de politie daarop in Karbi Anglong (Assam) 27 mannen die naar aanleiding van berichten op Facebook en WhatsApp dachten dat de twee mannen kinderen ontvoerden. Daarna arresteerde de politie nog eens 25 mensen voor het verspreiden van geruchten over kidnapping via social media. Al eerder dat jaar was naar aanleiding van soortgelijke geruchten een transgender vrouw en een met psychische klachten kampende man door een menigte aangevallen. En ook hier was er sprake van polarisatie. Studenten gingen namelijk na de moord op de twee vermeende kidnappers de straat op om te demonstreren tegen het door de bevolking van Karbi Anglong uitgeoefende geweld op de twee mannen.

Deel III – De impact van fake accounts en fake news

Kritiek vanuit DARPA

Door het ontbreken van adequate wetgeving zit de Amerikaanse overheid Facebook nauwelijks in de weg. Toch is er terdege wel kritiek vanuit die overheid. The Facebook dilemma gaat hierbij in op de rol van Rand Waltzman. Hij was in de periode 2010-2015 werkzaam bij DARPA (Defense Advanced Research Projects Agency), een Amerikaanse overheidsorganisatie die inzet op het ontwikkelen van nieuwe technologieën voor de nationale veiligheid. Waltzman keerde zich sterk tegen Facebook en stelde dat dit platform je data kan gebruiken om je te desinformeren en te manipuleren. Bijvoorbeeld als het gaat om ons stemgedrag, maar ook bij ons koopgedrag. Volgens hem is er hier sprake van ‘mass manipulation’. Waltzman schreef meer dan 200 artikelen waarin hij de kwalijke rol van Facebook aan de kaak stelt.

De trollen van Olgino

Om goed te begrijpen wat de rol van Facebook is in conflicten, moeten we benadrukken dat het vooral een facilitator is in het verspreiden van desinformatie. De informatie wordt niet door Facebook zelf online gezet, maar door anderen die van Facebook misbruik maken. Berucht is het Internet Research Agency (IRA) (zie foto) in de wijk Olgino in St. Petersburg, Rusland. De medewerkers van dit bedrijf worden ook wel ‘de trollen van Olgino’ genoemd. De medewerkers van IRA verspreidden in de periode 2010 tot en met 2018 vanaf 1.349 fake accounts honderdduizenden Facebook- en Twitter-posts gericht tegen de president van Oekraïne, Petro Poroschenko. Poroschenko was anti-Russisch en daarom werd hij door IRA zwart gemaakt. Bijvoorbeeld door berichten te verspreiden waarin ze stelden dat hij pro-Russische Oekraïners zou martelen en doden. Voor veel Oekraïners werd het daardoor moeilijk om feiten van fictie te kunnen scheiden.

Om goed te begrijpen wat de rol van Facebook is in conflicten, moeten we benadrukken dat het vooral een facilitator is in het verspreiden van desinformatie. De informatie wordt niet door Facebook zelf online gezet, maar door anderen die van Facebook misbruik maken. Berucht is het Internet Research Agency (IRA) (zie foto) in de wijk Olgino in St. Petersburg, Rusland. De medewerkers van dit bedrijf worden ook wel ‘de trollen van Olgino’ genoemd. De medewerkers van IRA verspreidden in de periode 2010 tot en met 2018 vanaf 1.349 fake accounts honderdduizenden Facebook- en Twitter-posts gericht tegen de president van Oekraïne, Petro Poroschenko. Poroschenko was anti-Russisch en daarom werd hij door IRA zwart gemaakt. Bijvoorbeeld door berichten te verspreiden waarin ze stelden dat hij pro-Russische Oekraïners zou martelen en doden. Voor veel Oekraïners werd het daardoor moeilijk om feiten van fictie te kunnen scheiden.

Op 17 juli 2014 werd vlucht MH-17 van Malaysia Airlines boven Oekraïne uit de lucht geschoten door een Buk-raket. Volgens onderzoekers was deze raket in Donetsk afgevuurd door pro-Russische separatisten. Op 18 juli – een dag na het neerhalen van de MH-17 – verspreidde IRA maar liefst 44.000 berichten op social media waarin Oekraïne als schuldige van deze vliegtuigramp werd aangewezen. Een adviseur van de Oekraïense regering (Dmytro Shymkiv) ging nadien hierover met Facebook in gesprek; maar Facebook verdedigde zichzelf door te stellen dat het een open platform is waar de ‘freedom of speech’ heilig is.

De Amerikaanse presidentverkiezingen van 2016

IRA speelde ook een rol bij de Amerikaanse presidentsverkiezingen van 2016. Evenals diverse kleine ‘fabriekjes’ in Veles, Macedonië. Laatstgenoemden produceerden met duizenden medewerkers op circa 200 websites enorm veel fake news. Een bericht stelde bijvoorbeeld dat de paus achter Donald Trump stond en een ander bericht dat Hilary Clinton wapens aan IS had verkocht. IRA investeerde tijdens deze presidentsverkiezingen een slordige $ 100.000 aan reclame om mensen naar bepaalde Facebook-groepen te lokken. Het ging er daarbij niet zo zeer om mensen van één bepaald standpunt te overtuigen, maar om met desinformatie mensen tegen elkaar op te zetten. Zo investeerde IRA in pro-immigratie en anti-immigratie groepen, in ‘black lives matter’ en ‘white supremacists’ groepen, alsmede in voor- en tegenstanders van wapenbezit. Volgens Alex Stamos (de voormalig security officer van Facebook) was in 2016 een groot cluster van berichten op Facebook erop gericht de presidentsverkiezingen te beïnvloeden.

IRA speelde ook een rol bij de Amerikaanse presidentsverkiezingen van 2016. Evenals diverse kleine ‘fabriekjes’ in Veles, Macedonië. Laatstgenoemden produceerden met duizenden medewerkers op circa 200 websites enorm veel fake news. Een bericht stelde bijvoorbeeld dat de paus achter Donald Trump stond en een ander bericht dat Hilary Clinton wapens aan IS had verkocht. IRA investeerde tijdens deze presidentsverkiezingen een slordige $ 100.000 aan reclame om mensen naar bepaalde Facebook-groepen te lokken. Het ging er daarbij niet zo zeer om mensen van één bepaald standpunt te overtuigen, maar om met desinformatie mensen tegen elkaar op te zetten. Zo investeerde IRA in pro-immigratie en anti-immigratie groepen, in ‘black lives matter’ en ‘white supremacists’ groepen, alsmede in voor- en tegenstanders van wapenbezit. Volgens Alex Stamos (de voormalig security officer van Facebook) was in 2016 een groot cluster van berichten op Facebook erop gericht de presidentsverkiezingen te beïnvloeden.

Bron: BuzzFeed (2016)

Het is belangrijk te realiseren dat gebruikers nepnieuws onderling eerder delen, omdat het inspeelt op basale emoties zoals angst en boosheid. Het voornaamste doel van de trollen van Olgino en de fake news fabriekjes in Veles (Macedonië) was het destabiliseren van de Amerikaanse samenleving door mensen tegen elkaar op te zetten. IRA bereikte tijdens de 2016-verkiezingen 150 van de 330 miljoen Amerikanen. Bij deze verkiezingen haalde 39% van de Amerikanen hun informatie van Facebook. Cijfers van BuzzFeed tonen aan dat op een gegeven ogenblik Facebook-gebruikers meer nepnieuws deelden dan echt nieuws. Sommigen trokken na deze Amerikaanse presidentsverkiezingen dan ook de conclusie “Facebook elected Donald Trump”.

De polariserende werking van fake news

Een voorbeeld van fake news dat goed illustreert wat de ervan effecten kunnen zijn, is het volgende. Op 3 september 2016 verscheen er op social media een bericht dat zogenaamd afkomstig was van The Seattle Tribune (een niet bestaande krant). In het bericht stond de tekst “Idaho mother sentenced to prison after multiple citations for breastfeeding in public”. Je kunt je indenken dat feministen hier fel op reageren en het belachelijk vinden dat een vrouw daarvoor naar de gevangenis is gestuurd. Wat meer conservatieve vrouwen zullen het naar de gevangenis sturen niet verdedigen, maar zullen het geven van borstvoeding in publieke ruimtes mogelijk wel afkeuren. Op deze wijze zorgt nepnieuws ervoor dat er polarisatie tussen groepen optreedt. Natuurlijk is Facebook niet verantwoordelijk voor de inhoud van het bericht, maar het algoritme van dit platform zorgt er wel voor dat dergelijk nieuws en de comments daarop gemakkelijk worden verspreid.

Een voorbeeld van fake news dat goed illustreert wat de ervan effecten kunnen zijn, is het volgende. Op 3 september 2016 verscheen er op social media een bericht dat zogenaamd afkomstig was van The Seattle Tribune (een niet bestaande krant). In het bericht stond de tekst “Idaho mother sentenced to prison after multiple citations for breastfeeding in public”. Je kunt je indenken dat feministen hier fel op reageren en het belachelijk vinden dat een vrouw daarvoor naar de gevangenis is gestuurd. Wat meer conservatieve vrouwen zullen het naar de gevangenis sturen niet verdedigen, maar zullen het geven van borstvoeding in publieke ruimtes mogelijk wel afkeuren. Op deze wijze zorgt nepnieuws ervoor dat er polarisatie tussen groepen optreedt. Natuurlijk is Facebook niet verantwoordelijk voor de inhoud van het bericht, maar het algoritme van dit platform zorgt er wel voor dat dergelijk nieuws en de comments daarop gemakkelijk worden verspreid.

De Amerikaanse presidentverkiezingen van 2020

Waar Donald Trump in 2016 bij de Amerikaanse presidentverkiezingen Hillary Clinton wist te verslaan, lukte hem dat in 2020 bij Joe Biden niet. Trump beschuldigde daarna de democraten ervan dat zij de verkiezingen hadden ‘gestolen’. Veel complotdenkers uit het Trump-kamp gingen daarin mee en protesteerden met de leus ‘Stop the steal!’. Uiteindelijk leidde dat op 6 januari 2021 (ook wel J6 genoemd) tot de bestorming van het Amerikaanse Capitool. Bij deze aanval vielen vijf doden te betreuren. Recent werd duidelijk dat tal van Facebook-medewerkers al ruim vóór de bestorming bij de Facebook-leiding alarm hadden geslagen over de toename van in potentie gevaarlijke, opruiende berichten op het platform. Ondanks dit heeft de leiding van Facebook geen stappen gezet om iets tegen deze berichten te doen.

“Dit is geen nieuw probleem”, stelde een anonieme medewerker naar aanleiding van de bestorming van het Capitool op het interne berichtensysteem van Facebook (Workplace). “We zien dit gedrag van politici als Trump en de op zijn zachtst gezegd besluiteloze acties van de bedrijfsleiding al jaren.” Een ander schreef volgens Associated Press: “We hebben dit vuur heel lang aangewakkerd en we moeten niet verbaasd zijn dat het nu uit de hand loopt.”

Frances Haugen (foto) werkte van 2019 tot 2021 voor Facebook; zij was ingehuurd om het verspreiden van desinformatie op het platform tegen te gaan. Zij verklaarde na haar vertrek voor de media het volgende: “De leiders van het bedrijf weten hoe ze Facebook en Instagram veiliger kunnen maken, maar doen dat niet omdat ze hun gigantische winsten boven mensen stellen”. En: “Facebook realiseert zich dat gebruikers na een wijziging van het algoritme minder lang op de site zitten, minder advertenties aanklikken en het bedrijf minder geld verdient.”

Frances Haugen (foto) werkte van 2019 tot 2021 voor Facebook; zij was ingehuurd om het verspreiden van desinformatie op het platform tegen te gaan. Zij verklaarde na haar vertrek voor de media het volgende: “De leiders van het bedrijf weten hoe ze Facebook en Instagram veiliger kunnen maken, maar doen dat niet omdat ze hun gigantische winsten boven mensen stellen”. En: “Facebook realiseert zich dat gebruikers na een wijziging van het algoritme minder lang op de site zitten, minder advertenties aanklikken en het bedrijf minder geld verdient.”

The Facebook dilemma: conclusies en aanbevelingen

Van groot belang is te realiseren dat Facebook zelf geen controversiële posts online zet. Dit gebeurt door kwaadwillenden die vaak vanaf fake accounts nepnieuws verspreiden. Maar het algoritme van Facebook zorgt er wel voor dat polariserende posts de berichtenstroom op Facebook domineren. Hierdoor wordt de onderlinge haat tussen groepen aangewakkerd met fysiek geweld tot gevolg. Facebook pakt controversiële content niet aan omdat (1) ze zich hiertoe moreel en wettelijk niet geroepen voelt, (2) dit afbreuk doet aan hun verdienmodel en (3) Facebook bij buitenlandse conflicten de taal vaak niet machtig is. Maar het is natuurlijk de vraag hoe lang Facebook dit kan volhouden. Daarnaast zou Facebook paal en perk kunnen stellen aan hun data mining activiteiten. Hier ligt een belangrijke rol weggelegd voor privacy-autoriteiten. En ten slotte moeten we niet vergeten dat zowel gebruikers als adverteerders Facebook ‘helpen’ op deze wijze voort te bestaan.

Voor nu kan Facebook de volgende concrete acties nemen:

- Het aanpassen van het algoritme waardoor controversiële content zoveel mogelijk wordt geweerd.

- Het (proactief) voorkomen van het aanmaken van fake accounts.

- Het (reactief) afsluiten van accounts die erop gericht zijn haat te zaaien.

- Het stoppen met de verkoop van data aan data-brokers, en gebruikers toestemming vragen om tracking pixels te mogen gebruiken.

- Een deugdelijke governance rond Facebook op te zetten waardoor er meer rekening wordt gehouden met maatschappelijke belangen.

Tot slot: deze post gaat over de periode voordat de Facebook-organisatie haar naam op 29 oktober 2021 naar Meta veranderde. Vandaar dat in deze post steeds over Facebook wordt gesproken.

Tot slot: deze post gaat over de periode voordat de Facebook-organisatie haar naam op 29 oktober 2021 naar Meta veranderde. Vandaar dat in deze post steeds over Facebook wordt gesproken.

Referentie(s)

Jacoby, J. (2018), The Facebook dilemma, part one (00:55:18). Frontline PBS, Arlington, VA.

Jacoby, J. (2018), The Facebook dilemma, part two (00:54:48). Frontline PBS, Arlington, VA.

Fincher, D. (2010), The social network (02:00:00). Columbia Pictures, Culver City, CA.

Frenkel, S., Kang, C. (2021), An ugly truth: inside Facebook’s battle for domination. Little, Brown Book Group, Hachette, UK.

Anderen bekeken ook

The Social Dilemma (Netflix): samenvatting en duiding

The Social Dilemma (Netflix): samenvatting en duiding

Faciliteer dat klanten reviews uploaden vanaf hun smartphone!

Faciliteer dat klanten reviews uploaden vanaf hun smartphone!

VPRO Tegenlicht documentaire over ‘deep fake news’

VPRO Tegenlicht documentaire over ‘deep fake news’

(00:45:06)